BLOG

人工知能 (AI) 戦略で考慮すべきリスク

ビジネスが、これ以上速くは変わらないと思っていた矢先、ChatGPTが突如登場しました。今では、生成AIがいたるところ浸透しています。AIは、画像を作成し、音楽を作曲し、本を書き、医学を変革しています。そして、企業のビジネスのやり方や従業員の仕事のやり方までも改革しています。

多くの企業はまだこの強力なテクノロジーを活用しておらず*1、追いつこうと躍起になっています。しかし、習得の難易度は高く、特にAIがもたらすリスクに関しては難しくなります。

*1:米国AMAの2023年の調査では、多くの企業でAI戦略がなく、AI活用のために従業員に教育を実施せず、ガバナンスが機能していないことが分かりました。調査の詳細は、こちらからダウンロードできます。

●日本語版 人工知能(AI)ブーム、企業はまだ準備ができていない

●英語版 Artificial Intelligence (AI) Is Booming, But Companies Are Not Ready

テクノロジーは新しいですが、AI関連の事故によって炎上したり、不名誉を被ったりした企業のリストは膨大であり、増え続けています。例えば、裁判所は、航空会社エア・カナダに対して、同社のチャットボットがビリーブメント運賃(近親者の危篤または不幸の際に利用できる特別運賃)について誤解を与えたとして、悲しみに暮れる乗客に損害賠償を支払うよう命じました。

『スポーツ・イラストレイテッド』誌は、捏造された署名とライターのプロフィールを含む記事を掲載し、勤勉な (人間の) ジャーナリストを激怒させたとされています。また、iTutorGroup (台湾オンライン英会話スクール) は、同社のソフトウエアが60歳以上の男性応募者と55歳以上の女性応募者を一貫して拒否したことを理由に、米国雇用機会均等委員会との訴訟において365,000ドルで和解しました。

企業が陥りがちな問題を避けつつ、AIをどのように活用できるのでしょうか。米国AMA (American Management Association) の専門家は、企業がAI戦略を策定する際に考慮すべきリストを作成しました。

データ品質:AIモデルの学習に使用されるデータは正確で代表的なものですか。高品質のデータセットは、AIモデルの出力が信頼でき、目的に沿ったものであることを保証するのに役立ちます。

データバイアス:学習データには、差別的または不公平な結果につながる可能性のあるバイアスがありますか。コンピューターサイエンスには、GIGO*2 (garbage in, garbage out) と呼ばれる古くからある概念があります。これは、ゴミを入れたら、ゴミが出てくること。またはその逆もしかりです。AIにおいて、データバイアスの重要性は、これまで以上に高まっています。

*2:GIGOとは、質の悪い情報や不正確なデータを入力すれば、それに基づいて処理された結果も同様に正しくないという考え方。

データプライバシー:機密情報や個人情報への不正アクセス、使用、開示のリスクはありますか。AIは、個人の好みや習慣などの機密情報を推測して広めてしまう可能性があります。

アルゴリズムバイアス:AIモデルは、人種、性別、または社会的・経済的地位などの要因に基づいて偏った差別的な結果を生み出す可能性があるでしょうか。AIは膨大なデータセットからパターンを見つけ出す能力があるため、人間のアナリストにとって問題となる潜在的な偏見をアルゴリズムは発見し、それを助長してしまう可能性があります。

モデルの解釈可能性*3:AIモデルには透明性があり、解釈可能ですか。それとも意思決定プロセスが不明瞭な「ブラックボックス」として動作しますか。モデルがどのように決定するかを理解できないと、問題のある出力を特定したり修正したりすることが難しくなります。

例えば、モデルが特定のローン申請者や求職者を拒否する場合、その理由を知ることが重要です。現時点では、「説明可能なAI*4」はまだ発展途中の分野であるため、企業はリスクの高い用途にモデルを使用する際には注意を払うべきです。

*3: モデルの解釈可能性 (model interpretability) とは、機械学習モデルが入力に対してなぜそのような出力をしたのか、というモデルの振る舞いを理解できる度合いを指します。

*4: 説明可能なAI (explainable AI) とは、AIが導き出した答えについて、「なぜその答えを出したのか」が後から説明できる能力を指します。

モデルのパフォーマンス:AIモデルのパフォーマンスは、異なるデータセットやシナリオにおいて一貫性があり、正確で信頼できますか。一貫性と信頼性は、モデルが適応可能であり、単に例を記憶するのではなく、真に学習し、傾向を識別していることを示す指標となります。

法令遵守:AIの導入は、データ保護、プライバシー、差別に関する関連する法律、規制、業界標準に準拠していますか。主な懸念事項には、著作権侵害に関する訴訟や、2024年3月に成立したEUの「AI法」が含まれます。この法律は、履歴書のスキャンなどの実務を規制しています。

統合の課題:AIソリューションを既存のシステム、プロセス、ワークフローに統合する際に、リスクはありますか。企業は、AIが互換性やセキュリティ、過度な依存などの懸念を引き起こすかどうかといった、さまざまな可能性を考慮しなければなりません。

セキュリティの脆弱性 (ぜいじゃくせい) :AIシステムは、データの完全性やシステムの信頼性が損なわれるサイバー脅威やハッキング、または不正アクセスに対して脆弱ですか。AIインフラ (クラウドサーバーなど) を通じた従来のサイバー攻撃に加え、AIシステムはモデルの盗難に弱く、敵対者によって操作されて誤った有害な回答を出すように仕向けられる可能性があります。

パフォーマンスの低下:AIシステムが、業務に影響を与えるパフォーマンスの低下やダウンタイム、障害を起こす可能性はないでしょうか。モデルは、概念ドリフト*5やデータドリフト*5、モデルの衰退*5といったさまざまな技術的問題に対して脆弱である可能性があります。

*5:ドリフト (drift) とは、AI応答の性能が時間とともに徐々に低下する現象を指します。モデルの衰退(model decay) とも呼ばれます。ドリフトは主に2種類に分けられ、概念ドリフト (concept drift) とデータドリフト (data drift) があります。

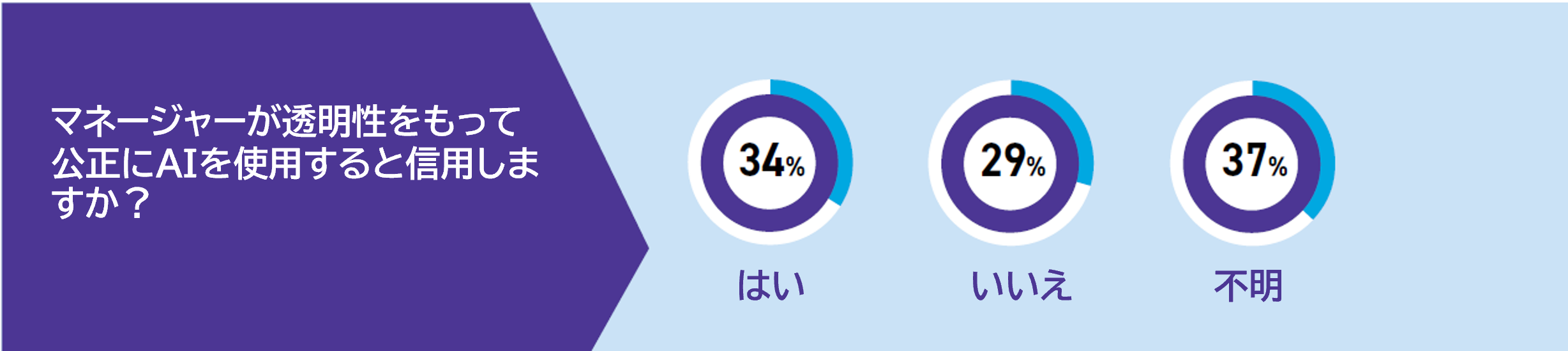

チェンジマネジメント:従業員、利害関係者、顧客が抵抗するリスクはあるでしょうか。そのリスクは現実的であり、管理されなければなりません。2023年のAMAの調査で、「マネージャーがAIを公正かつ透明性をもって使用すると信用しますか」の問いに、29%が「いいえ」と回答しています。また、37%が不明と回答しました。

このように考慮すべき項目が多くなると、AIを扱うには危険すぎるように思えるかもしれません。もちろん、ビジネスは常にリスクを伴います。リスクを最小限にするために慎重に進めれば、競合他社が先にAIを活用して優位に立つという現実的なリスクを生む可能性があります。

リスクについてチームを教育し、対応できる優秀な従業員に任せることで、できるだけ安全に前進できます。ことわざにもあるように、「港に停泊している船は安全だが、船はそのために作られたものではない」です。

*本記事は米国AMA (American Management Association) で配信されたものを、許諾を得て掲載しています。

AI関連研修

次のコースは、AIについて理解を深め、すでにどのように活用されているのか、そしてどのようなビジネスチャンスがあるのかを学びます。

人工知能(AI) ビジネスエッセンシャル ~AIのビジネス機会、ツール、リスク、メリットに関する実践的な知識を身につける~